正文

最近,卡耐基梅隆大学(CMU)的王小龙等人发表的论文《A-Fast-RCNN: Hard Positive Generation via Adversary for Object Detection》引起了很多人的关注。该研究将对抗学习的思路应用在图像识别问题中,通过对抗网络生成遮挡和变形图片样本来训练检测网络,取得了不错的效果。该论文已被 CVPR2017 大会接收。

论文链接:http://www.cs.cmu.edu/~xiaolonw/papers/CVPR2017_Adversarial_Det.pdf

Github:https://github.com/xiaolonw/adversarial-frcnn

论文:A-Fast-RCNN: Hard Positive Generation via Adversary for Object Detection

摘要

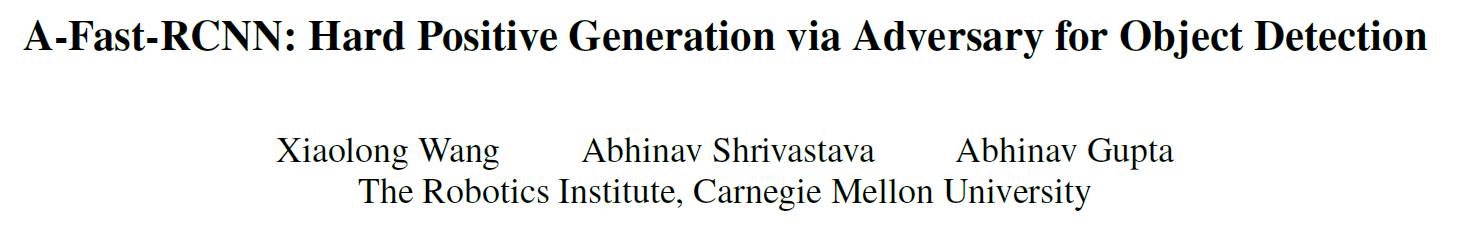

如何确定物体探测器能够应对被遮蔽、不同角度或变形的图像?我们目前的解决方法是使用数据驱动的策略,收集一个巨大的数据集——覆盖所有条件下物体的样子,并希望通过模型训练能够让分类器学会把它们识别为同一个物体。但是数据集真的能够覆盖所有的情况吗?我们认为像分类、遮蔽与变形这样的特性也符合长尾理论。一些遮蔽与变形非常罕见,几乎永远不会发生,而我们希望训练出的模型是能够应付所有情况的。在本论文中,我们提出了一种新的解决方案。我们提出了一种对抗网络,可以自我生成遮蔽与变形例子。对抗的目标是生成物体探测器难以识别的例子。在我们的架构中,原识别器与它的对手共同进行学习。实验证明,我们的方法与 Fast-RCNN 相比,在 VOC07 上的 mAP 上的升幅为 2.3%,在 VOC2012 物体识别挑战中的 mAP 升幅为 2.6%。我们同时发布了本研究的代码。

图 1:在论文中,我们提出了使用对抗网络来生成带有遮挡和变形的例子,从而让物体探测器难以进行分类。随着探测器的性能逐渐提升,对抗网络产生的图片质量也在提升。通过这种对抗策略,神经网络识别物体的准确性得到了进一步提升。

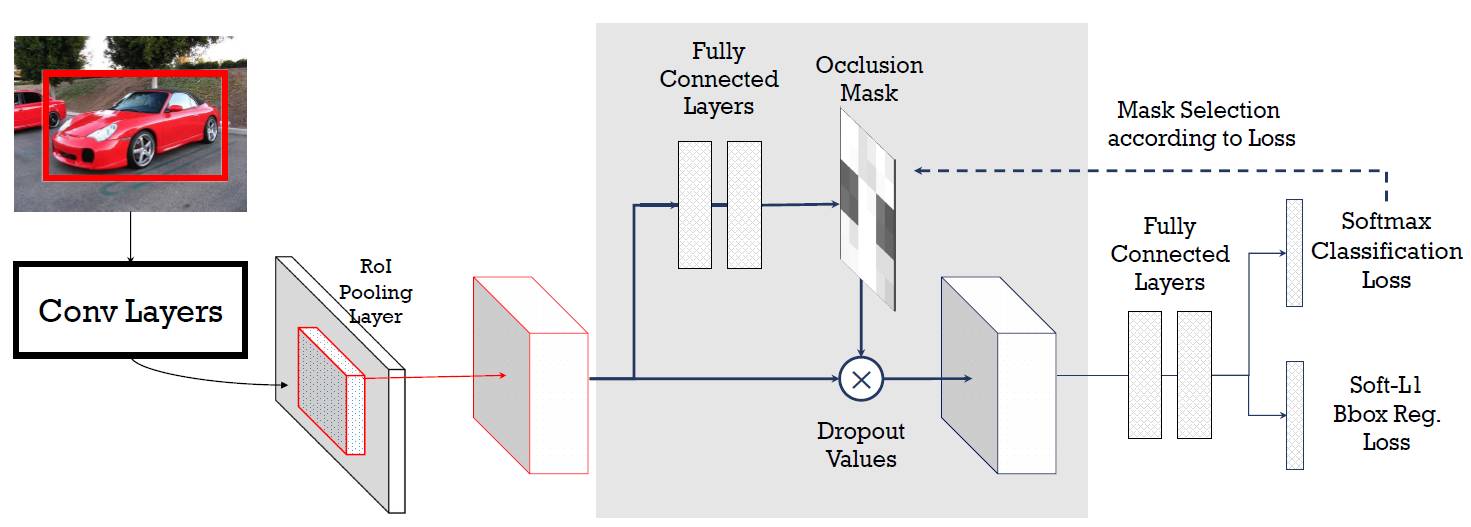

图 2:该方法的 ASDN 网络架构以及如何与 Fast RCNN 结合的示意图。我们的 ASDN 网络使用输入图片加入 RoI 池化层中得到的补丁。ASDN 网络预测遮挡/极高光蒙版,然后将其用于丢弃特征值,并传递到 Fast-RCNN 分类塔。