正文

左图:人类演示 右图:相应的机器人模拟

在非常小的数据集上使用无监督学习是机器学习中最具挑战性的场景之一。为了使该方法可行,研究者使用了从ImageNet上进行图像识别训练的大型网络的深度视觉特征。这种深度视觉特征对于语义概念是敏感的,能够很好的提取语义概念,同时防止诸如外观和照明等变量的干扰。研究者使用这些功能来解释用户提供的演示,结果显示从几个演示中就可以以无监督的方式学习到奖励函数,而无需额外训练。

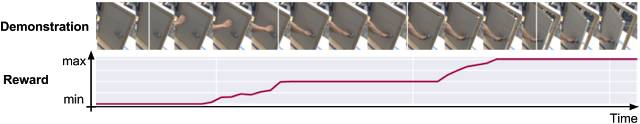

在从观察中学习到奖励函数之后,研究者用它来引导机器人学习开门任务,只使用图像来评估奖励函数。借助初始的动作演示,机器人有10%的时间能够成功完成开门动作,而在机器人使用学习到的奖励函数继续学习之后,准确率则能够提高到100%。

学习过程

通过自我监督和模仿来模仿人的动作

在「Time-Contrastive Networks: Self-Supervised Learning from Multi-View Observation」这篇论文中,谷歌的研究者提出了一种从观察中学习世界的新颖方法,并通过自我监督的姿态模拟实验证明了该方法的可行性。该方法主要依靠的时间和空间的同时性进行监督:通过训练区分视频不同时期的帧,该方法学会将现实分解和组织成有用的抽象表示。