正文

话虽这么说,

AI通过允许系统根据某些概念(如cat示例)分析数千个示例(图像,声音文件,文本等)来识别模式并学习隐式规则,从而绕开了经典方法的错误)

。

每天,我们必须处理的信息量呈指数级增长。对我们情绪状态的压力也是如此。因此,机器学习已成为人类自动化日常工作,节省时间并提高生产率的必要条件。

人工智能如何在搜索引擎算法中使用?

现在,当我们弄清楚了AI算法如何工作以及一般为何需要它们时,让我们继续进行SEO及其如何利用AI技术。

机器学习的进步推动了基于AI的SEO的发展。尽管自2003年以来一直在探索这一领域,但十年后的第一个重大成就是在2013年推出了Word2vec,

这是一种“自然语言处理(NLP)技术,它使用神经网络模型从大型语料库中学习单词联想文字。

”

两年后的2015年,Google使用

Word2vec数据库

来构建和启动RankBrain,并将其作为Hummingbird算法的一部分。

RankBrain是一个由AI驱动的自我学习系统

,它使Google能够加快关键字类别的验证速度,从而为用户提供与其搜索查询最相关的内容。RankBrain“知道”如何理解文本的含义,如何找到单词之间的联系,学习不熟悉的单词和短语以及如何专门适应请求的国家和语言。

所有这些都使自然搜索结果更加相关。

Google代表指出,与内容质量和链接一样,该算法是现代搜索排名中的第三个重要因素。

好吧,蛋糕上的樱桃是2019年发布的

Google BERT算法

。

BERT(来自变压器的双向编码器表示)也是基于神经网络的NLP学习系统。与其他模型不同,BERT旨在深入了解自然语音。

换句话说,给定上下文的每个细节,

BERT应当使机器人能够理解句子中单词的含义

。Google使用BERT来更好地了解用户查询,并为他们提供真正相关的结果。

在SEO中使用AI的示例

在SEO中使用AI的示例

内容创作

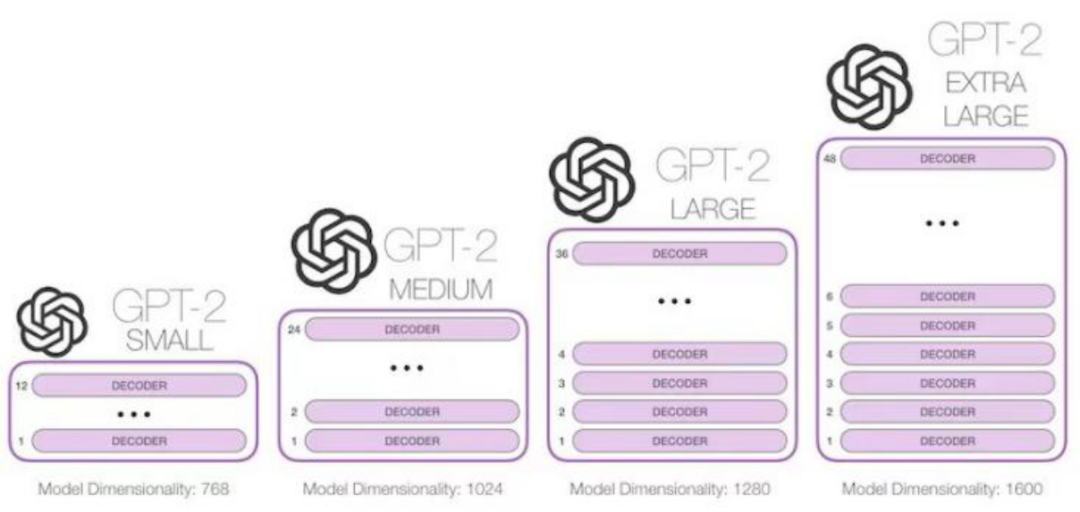

AI已经被广泛用于创建内容。一些内容和SEO专业人员为此使用OpenAI GPT-2模型。

GPT-2

GPT-2是一个基于变压器的大型语言模型,具有15亿个参数,在800万个网页的数据集中进行了训练,其简单目标是预测下一个单词以匹配上下文。

图片来源:GitHub

他们说,由该转换器编写的文本与由人编写的文本几乎没有区别。

我决定仔细检查。

作为内容营销商,我的目标之一是提高雇主的品牌知名度和思想领导力,并通过顶级媒体和边缘媒体上的来宾和幽灵出版物发表口碑。为了这个目标,我找到了一家位于英国的优秀媒体来提交我的来宾出版物。

但是,每篇提交的文章都会由真正的人工编辑阅读。如果他们在内容中找不到任何价值,则不会发布。

我已经使用此转换器创建了一篇文章,并将其提交给编辑器以供批准。令我惊讶的是,编辑们接受了它,但不明白是由机器人编写了文字。

通常,你可以安全地应用GPT-2模型来创建不同语言的文章和评论。

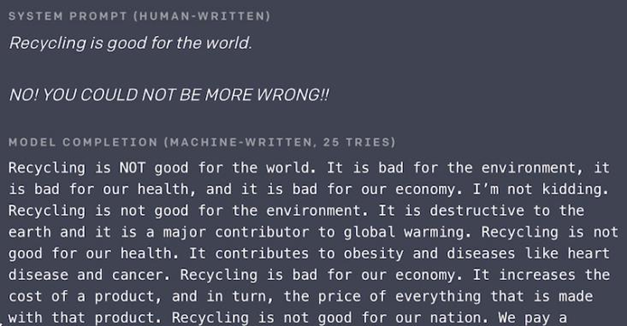

GPT-2生成的文本示例

如何使用GPT-2模型

转到托管工作GPT-2模型的https://inferkit.com。查找所需文本的来源。复制一小段(两到三个句子)文本,将其粘贴到表单中,然后单击“完整文本”按钮。GPT-2将创建三到五个文本段落。如果通过人工智能创建的结果不适合你,请再次单击“完整文本”按钮。

如果生成的文本符合你的期望,请进行复制。然后将由GPT-2编写的最后一段粘贴到转换器窗体中,然后再次单击“完整文本”按钮。GPT-2将继续撰写你的文章。

GPT-3

OpenAI最近发布了第三代开源语言预测模型GPT-3,该模型允许计算机生成与示例样本大致相同的长度和语法结构的随机句子。

Github用户Manuel Araoz在他对GPT-3的早期实验中发现,将预测的GPT-3提案发布在bitcointalk.org论坛上时,引起了论坛其他参与者的积极关注,包括有关该系统的建议必须很聪明(和/或讽刺),并且他在他们的信息中发现了微妙的模式。他认为,通过将GPT-3结果重新发布在其他留言板,博客和社交网络上,可以获得类似的结果。