正文

下面,我们简单介绍最佳论文。

最佳论文一:密集连接卷积网络

摘要

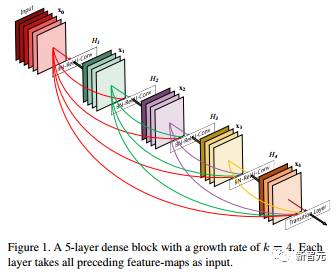

最近的研究显示,如果卷积网络中分别接近输入端和输出端的层之间包含更短的连接,那么该卷积网络可以显著地实现更深、更准确,并且更高效。在本研究中,我们同意这一观察,并提出DenseNet(Dense Convolutional Network),它以前馈的方式将所有层连接起来。一个L层传统卷积网络具有L个连接——即每一层和它的后一层之间都有一个连接,我们提出的DenseNet网络具有L(L + 1)/2个直接连接。对于每个层,它的输入是所有前面的层的特征图,并且其自身的特征图被用作所有后面的层的输入。DenseNet的突出优点有几点:减轻了梯度消失的问题,加强了特征传播,鼓励特征重用,并且大大减少了参数数量。我们在4个高度竞争性的对象识别基准任务(CIFAR-10,CIFAR-100,SVHN和ImageNet)中对我们提出的架构进行了评估。结果显示,DenseNet 在大多数任务上相比以前的最优结果获得了显著的进步,并且在实现高性能的同时所需的内存和计算更少。相关代码和模型可以在这里找到:https://github.com/liuzhuang13/ DenseNet

最佳论文二:通过对抗训练从模拟图像和无监督图像学习

摘要

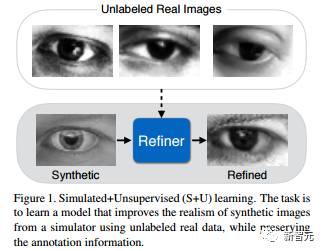

随着图形学最近得到的进步,使用合成的图像训练模型变得更加容易了,这能免除对数据进行注释的昂贵花费。但是,由于合成的图像和真实图像分布之间存在差距,从合成的图像学习可能无法实现期望的性能。为了缩小这一差距,我们提出模拟+无监督(Simulated+Unsupervised,S + U)学习,它的任务是学习一个模型,以使用未标记的真实数据来改善模拟器的输出的真实感(realism),同时保留来自模拟器的注释信息。我们为S + U学习开发了一种使用对抗网络的方法,类似生成对抗网络(GAN),但我们的方法使用合成的图像(而非随机向量)作为输入。我们对标准GAN算法进行了几个关键的修改,以保留注释信息,避免失真(artifacts)并保持训练稳定:(i)一个“自正则化”项,(ii)一个局部对抗损失( local adversarial loss),以及(iii)使用改善后的图像的历史信息来对判别器进行更新。我们的研究表明,这一方法能够生成高度逼真的图像,并且通过定性研究和用户研究证实了这一点。我们通过训练模型进行视线估计(gaze estimation)和手势估计(hand estimation)进行了定量评估。我们的研究显示,这一方法在使用合成图像方面实现了显著提升,并在没有任何已标注数据的情况下,在 MPIIGaze 数据集得到了 state-of-the-art 的结果。

最佳学生论文

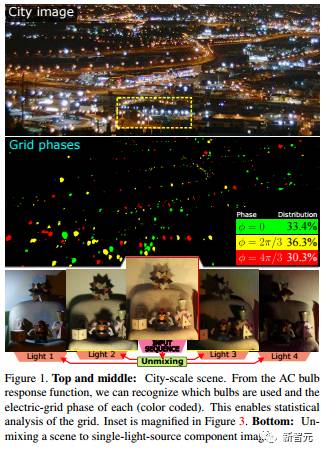

:电网计算成像(Computational Imaging on the Electric Grid)

摘要

交流电(AC)照明带来了夜的节拍。 通过对这种节拍的感受,我们揭示了新的场景信息,包括:场景中的灯泡类型,城市规模的电网分段(phase)以及光传输矩阵。这种信息区分了反射和半反射,夜间高动态范围以及在采集期间未观察到的灯泡的场景渲染(scene rendering)。 后者由我们收集并提供的来源丰富的灯泡响应函数数据库促成。为了实现以上工作,我们构建了一种新颖的 coded- exposure 高动态范围成像技术,专门设计用于在电网交流照明上运行。

大会还公布了Longuet-Higgins 奖和PAMI 年轻研究员奖:

Longuet-Higgins 奖是 IEEE 计算机协会模式分析与机器智能(PAMI)技术委员会在每年的 CVPR 颁发的“计算机视觉基础贡献奖”,表彰十年前对计算机视觉研究产生了重大影响的 CVPR 论文。奖项以理论化学家和认知科学家 H. Christopher Longuet-Higgins 命名。

2017 年的Longuet-Higgins 奖被授予了 J. Philbin 等人在 2007 年发表的 CVPR 论文“Object retrieval with large vocabularies and fast spatial matching”。根据谷歌学术搜素引擎,这篇文章的被引次数高达 2122 次。

另一个奖项是“PAMI 年轻研究员奖”(PAMI Young Researcher Award),这个奖项授予那些博士毕业不超过 7 年并在计算机视觉方面有卓越研究贡献的的年轻研究人员。PAMI 年轻研究员奖自 2013 年起颁发,继承了 2012 年IVC 的“杰出青年研究员奖”(Outstanding Young Researcher Award)。

2017 年的 PAMI 年轻研究员奖得主是 Ross Girshick(Facebook AI Research,FAIR) 和 Julien Mairal(INRIA)。

从以上多个奖项的获奖者来看,虽然华人学者在CVPR的论文提交数量和竞赛上有出色表现,但是获奖的比例并不算高。

接收论文:华人学者的半壁江山依然稳固,“深度学习”稳坐关键词第一把交椅

今年,CVPR 共收到2680篇有效投稿,其中2620篇经过完整评议(其余60篇有一些是出于技术或伦理方面的原因被委员会拒绝,有一些则在评议前退出)。

最终,一共有783篇论文被接收(接收率为29%)。其中有71篇获得长篇口头报告的展示机会,144篇获得短报告(spotlights)的机会。

CVPR 2017的接收论文有三种展示形式:两种形式的口头展示(长篇与短篇,即Oral 与 Spotlights),以及海报展示。新智元统计发现,大会一共有107个Session。

-

ORALS:与传统的CVPR orals 一样,CVPR 2017 上进入 orals 环节的论文数量比例与此前几届CVPR一致。每一个orals 报告的时间是12分钟。

-

SPOTLIGHTS: 每一个spotlight的报告者有4分钟的口头报告时间,来强调论文的主要贡献和创新之处,以及报告论文的主要研究成果。

-

POSTERS: 口头报告之外的论文将会得到海报展示的机会。此外,所有的口头报告之外的论文也会出现在接下来的海报展示环节中。

全部论文名单地址:http://www.cvpapers.com/cvpr2017.html