正文

论文一:内审式分类器学习:生成式地使能(Introspective Classifier Learning: Empower Generatively)

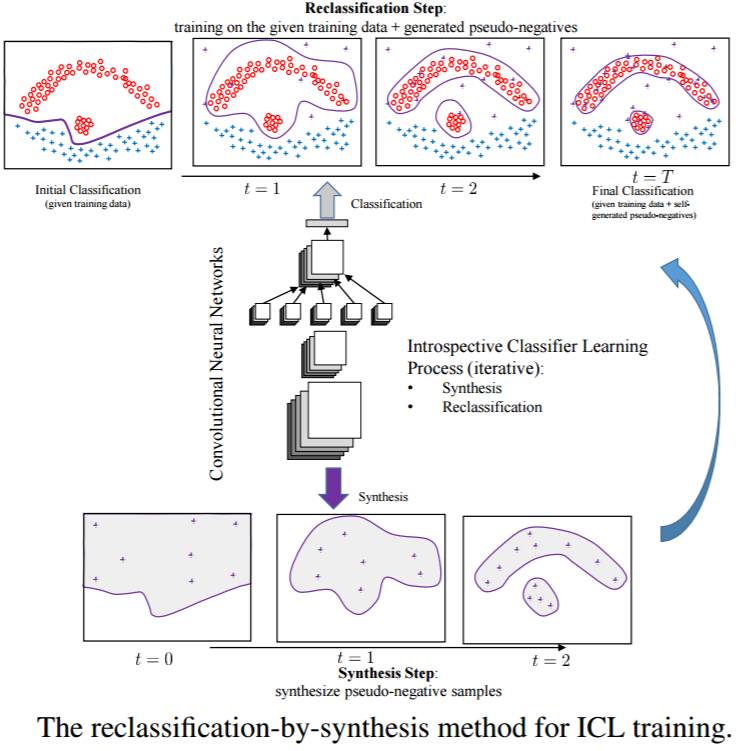

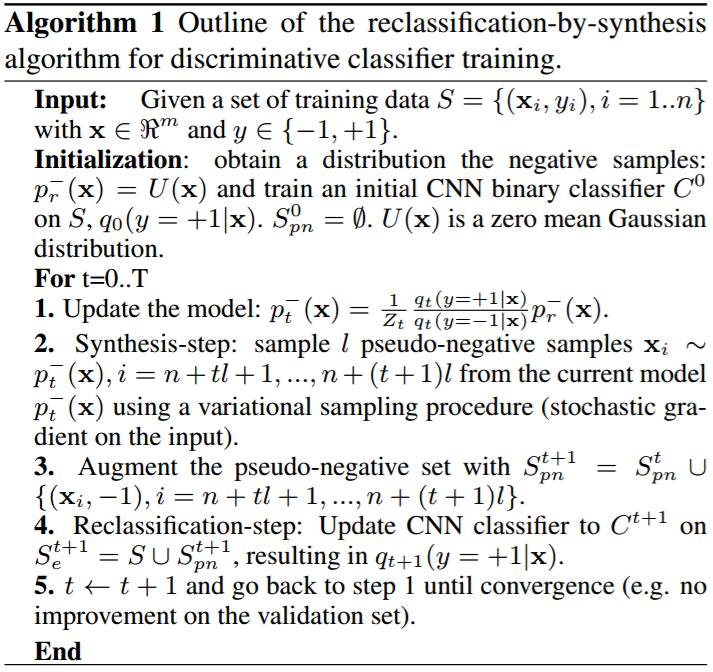

在这篇论文中,我们提出了内省式分类器学习(ICL:introspective classifier learning),其强调了有一个具有生成能力的判别式分类器的重要性。我们开发了一个通过合成的再分类(reclassification-by-synthesis)算法来使用一种源自贝叶斯理论的公式进行训练。我们的分类器能够迭代式地做到:(1)在合成步骤中合成假负例样本(pseudo-negative sample);(2)在再分类(reclassification)步骤中通过提升分类来增强自身。学习到的单个分类器同时也具有生成能力——能够在自己的判别模型内直接合成新样本。我们使用当前最佳的 CNN 架构在标准的基准数据集(包括 MNIST、CIFAR 和 SVHN)上进行了实验,并观察到了分类结果的提升。

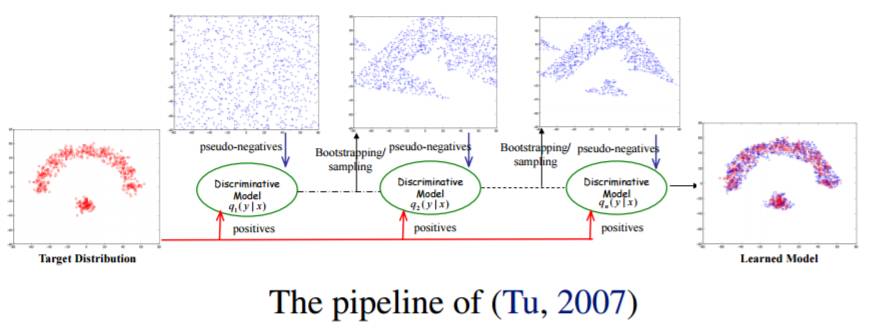

图 1:(Tu, 2007) 中开发的 GDL 方法的流程图(图示为一个简单示例),展示了通过一个判别分类器的序列使用自我生成的假负例样本来训练一个生成模型的方法。

图 2:我们提出的用于 ICL 训练的通过合成的再分类(reclassification-by-synthesis)算法的示意图。左上图展示了输入的训练样本,其中红色圈表示正例,蓝色十字表示反例。底部图是合成步骤中由分类器逐渐自我生成的样本,顶部图给出了决策边界(紫色),其在再分类步骤中逐渐更新。假反例(紫色十字)是逐渐生成的,可帮助增强决策边界。我们仅维持了一个单个 CNN 分类器,而不是在 GDL 中具有多个 boosting 分类器(参见图 1)

算法 1:用于判别式分类器训练的通过合成的再分类(reclassification-by-synthesis)算法

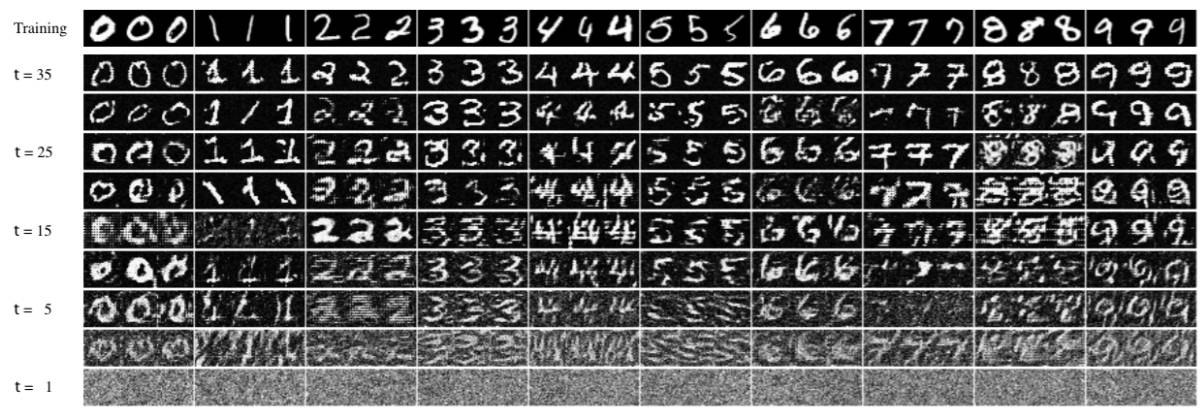

图 3:我们的 ICL 分类器为 MNIST 数据集合成的假反例。顶行给出了一些训练样本。随着 t 增加,我们的分类器会逐渐合成对训练样本越来越真实的假反例