专栏名称: 微软科技

| 微软中国的认证公众号,分享微软产品资讯,技术方案,成功案例,行业视野,精彩活动。第一时间获取微软在云计算,大数据,移动,企业社交商务等话题的解决方案。 |

目录

相关文章推荐

|

新浪科技 · 【#蜜雪冰城称累晕员工是低血糖#】6月7日, ... · 9 小时前 |

|

|

北京生态环境 · 北京碳市场平稳运行11个履约周期 有效促进碳减排 · 9 小时前 |

|

|

北京生态环境 · 北京碳市场平稳运行11个履约周期 有效促进碳减排 · 9 小时前 |

|

新浪科技 · 【#AI让听障人士无负担开启发音练习#】在无 ... · 昨天 |

|

新浪科技 · 【独家 | ... · 2 天前 |

|

新浪科技 · 【#小米SU7交付超25万台##雷军称强大的 ... · 2 天前 |

推荐文章

|

新浪科技 · 【#蜜雪冰城称累晕员工是低血糖#】6月7日,浙江温州,据网友发布-20250608184500 9 小时前 |

|

|

北京生态环境 · 北京碳市场平稳运行11个履约周期 有效促进碳减排 9 小时前 |

|

|

北京生态环境 · 北京碳市场平稳运行11个履约周期 有效促进碳减排 9 小时前 |

|

新浪科技 · 【独家 | #居然之家品牌店爆雷后续#:#欧铂尼垫资交付后向经销-20250606204100 2 天前 |

|

新浪科技 · 【#小米SU7交付超25万台##雷军称强大的产品力是高销量的基础-20250606140020 2 天前 |

|

腾讯大秦网 · 零下-5°的西安街头,市民的施舍、溃烂的右腿、止痛消炎药……是他生活的全部 8 年前 |

|

单读 · 法国人眼中的中国作家丨讲座 7 年前 |

|

孔明湿兄 · 内涵图 | 妹子!你们害羞也不用裙子挡脸啊 7 年前 |

|

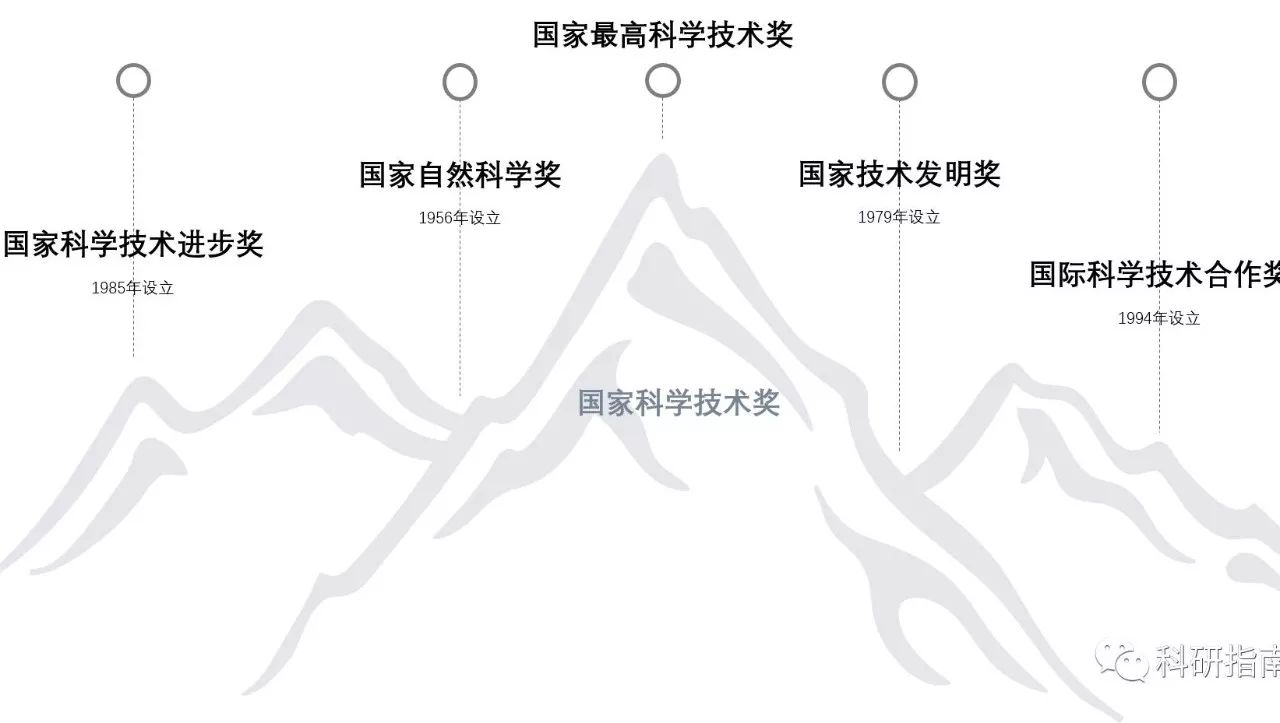

科研指南针 · 一条藤上五朵花,一个家里五个娃|趣谈国家科学技术奖 7 年前 |

|

城市数据团 · 【有奖竞猜】换个视角,还认识你熟悉的城市吗? 7 年前 |