正文

只是因为一台机器通过图灵测试从而证实计算机和人类在智能上无区别,并不意味着它是有意识的。对我们来说,先进的人工智能可能会导致机器看起来是意识的假象,但是在自我自觉方面,它并不比一块岩石或计算器更能感知自我意识。

◆

◆

◆

误解三:"我们不应该害怕人工智能。“

现实:

今年一月,facebook创始人Mark Zuckerberg说我们不应害怕人工智能,他说这将会为世界创造很多令人惊异的好东西。他只对了一半。我们安然享受人工智能所能创造的巨大的好处:从无人驾驶汽车到新药的制造, 然而我们却无法保证所有通过人工智能所实现的将会是良性的。

一个高度智慧的系统也许能了解完成一个特定任务所需要的所有知识,例如解决一个让人头痛的财务问题,或者侵入一个敌人的系统。但除开这些它所专长的特定的领域外,它很可能非常无知和愚昧。Google的DeepMind系统精通于围棋,然而除了围棋,它对于其他领域却没有任何推理和逻辑能力。

许多类似的系统也可能缺乏深入的安全考虑。一个很好的例子就是由美国和以色列军方共同开发的一份非常强大而复杂的武器级病毒系统Stuxnet Virus,其原本的作用是为了潜入和攻击伊朗核武器动力装置。此病毒系统却不慎(至于是有人故意而为之还是纯属意外则不得而知)感染了俄罗斯核武器动力装置。

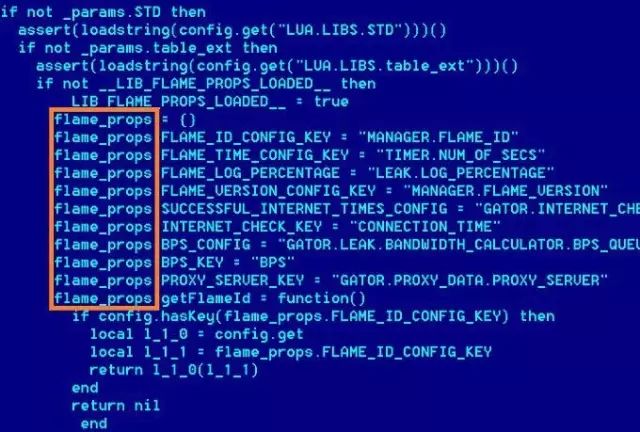

攻击网络间谍的Flame病毒

类似的例子还有在中东用于攻击网络间谍的程序:Flame。可以想象,未来类似Stuxnet或者Flame这样的系统如若广泛散布,可能对一些含有有敏感信息的基础设施产生一系列不可估量的破坏。(作者注:在此澄清,这些病毒并非人工智能,但在将来他们可以轻易加入人工智能,因此也将会带来以上的一些顾虑。)

◆

◆

◆

误解四:“人工智能由于其极高智能,将不会犯任何错误。”

电影《The Invisible Boy》中的超级计算机

电影《The Invisible Boy》中的超级计算机

现实:

Surfing Samurai机器人人工智能研究者和开发者,Richard Loosemore认为大多数假设的人工智能将毁灭世界的情景都非常不符合逻辑。大多数类似的假设总是认为人工智能将会说:“我知道毁灭人类文明是由于设计引起的故障,但无论如何我还是很想去做。”Loosemore指出如果人工智能在打算毁灭人类时,其思路是如此自相矛盾的话,它将在其一生中面临无数自相矛盾的逻辑推理,也因此会干扰了其认知从而变得非常愚蠢,而同时根本不足以对我们造成伤害。他同时也断言,那些认为“人工智能只会做程序设定的任务”的人,将会像在电脑刚刚发明时那些说电脑将永远不会具备应变能力的谬论的人一样。

牛津大学人类未来研究所(Future of Humanity Institute)的Peter Mcintyre和Stuart Armstrong对此有不同看法。他们认为人工智能将很大程度上依赖其程序锁定。他们不相信人工智能不会犯错误,或者反过来他们没有聪明到可以理解我们希望他们能做什么。

McIntyre告诉作者:“从定义上讲,人工智能就是一个在方方面面都比最聪明的人脑要更为聪明的智慧载体”。“它将会完全知道我们设计他们来做什么”。McIntyre和Armstrong相信人工智能将只会做其程序编写的任务,但如果它足够聪明的话,它会最终理解法律的精髓和人文的意义。